Zirraratik zarradarako mugan dabil teknologiaren demokratizazioa dantzan. Behinola joandako eta miretsitako artista kantuan entzun eta ikustea baita bata, eta maite zenuen hurbilekoa edo maite bai baina inoiz ezagutu gabekoa keinuka eta mugimenduan ikustea bestea. Zirraratik zarradarako mugan dabiltza hildakoen berpizteak. Izan hologramak, izan adimen artifizialaren ehunka aldaerak. Adituek diote erabileraren eta erabiltzaileen araberakoak direla mugak eta arriskuak. Eztabaida puri-purian jarri duena da, ordea, keinuka, mugimenduan eta hizketan jarri direnean, berez ez keinurik, ez mugimendurik eta ez hitzik egin ez dutenak. Eta horren erabilerak. Tranpak, engainuak, badu izena: deep fake (faltsutze sakona). Egin edo esan gabekoak egia bihurtzeak sortzen duen kezka bezalakoa: sakona.

Biziz berritzen direla hildakoak. Hori da funtsean teknologia horiek duten berdintasuna. Hologramen erabilera eta ondorioen eztabaida atzerago gelditu da orain, baina hura izan zen lehenengoa. Teknologia, ez da berbera. «Holograma proiekzio mota bat da, baina proiekzioa plano batean izan beharrean —zinean bezala—, airean egiten da. Horretarako pixel holografikoak erabiltzen dira. Pixel mota horiek, laser bitartez eta distantzia ezberdinetan, hiru dimentsioko figura bat egin dezakete. Horretarako, ikuspuntu ezberdinetan jarritako kamerak erabiltzen dira. Prozesu konplexua da benetan», azaldu du Unai Elordik, Vicomtech fundazioko ikerlariak.

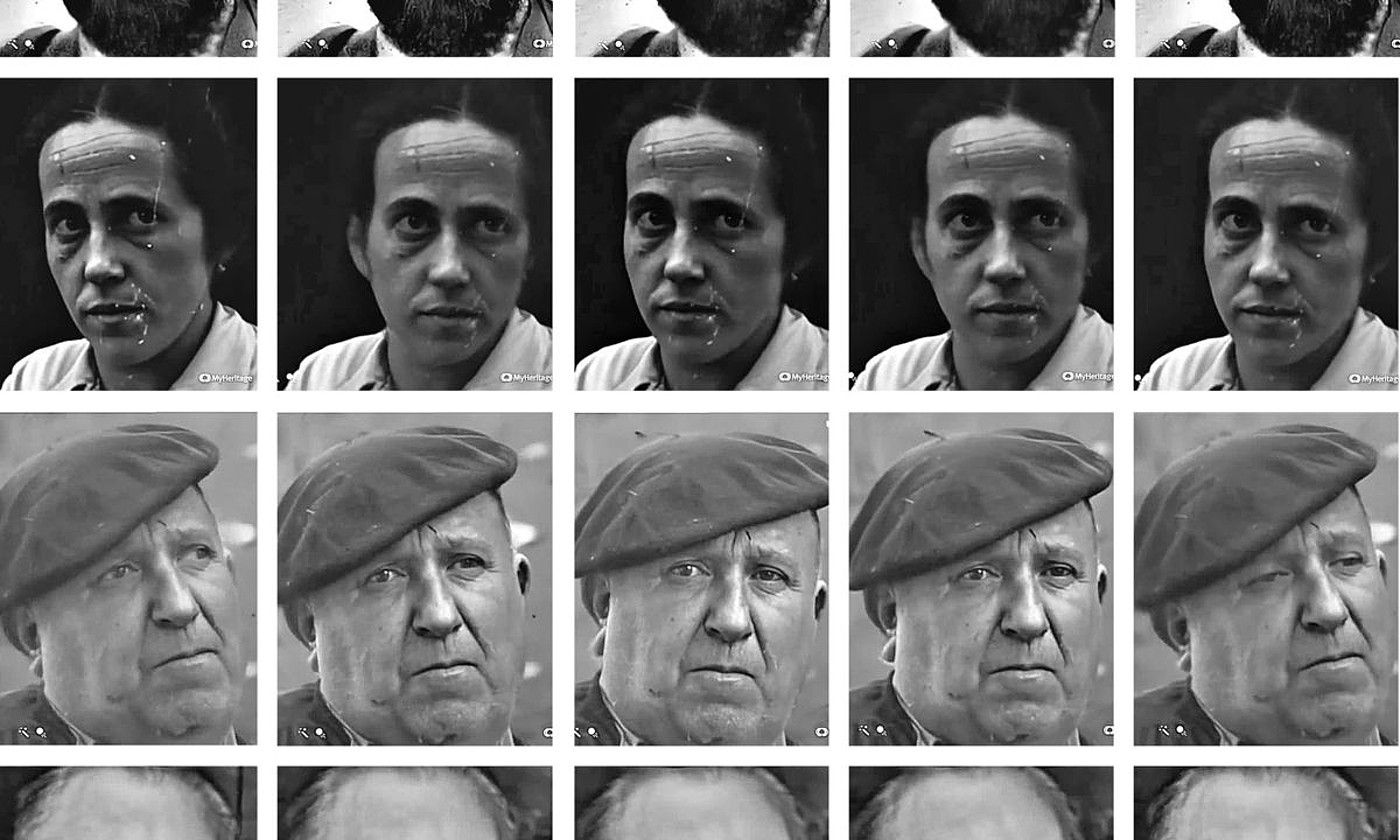

Azken hilabeteotan, ordea, hainbat plataforma adimen artifizialean oinarrituriko teknologia denon esku ari dira jartzen, hildakoak biziz berritzeko. MyHeritage konpainiak sarean jarritako Deep Nostalgia da zeresan gehien eman duena. Funtsean, aukera ematen du argazki zahar (edo berri) bat hartu, eta irudian agertzen den pertsonari mugimendua emateko. Elordik azaldu du «irudiak biziberritzeko» aplikazio bat dela, eta «adimen artifizialeko teknikak» erabilita lortzen dela hori. Zer dago atzean?: «Atzean daudenak aktoreek grabatutako bideoak dira. Aurpegia mugitzen dute, begiak mugitzen dituzte, nolabait bizirik daudela demostratzen duten aurpegi espresioak definitzen dituzte». Nola, ordea?: «Adimen artifizialean oinarritutako teknika bat erabiltzen dute:GAN Generative Adversarial Networks izeneko sareak, hain zuzen ere. Sare horiek irudiak sortzen ikasten dute, eta, kasu honetan, aldez aurretik entrenatuta daude, nolabait, aktoreen bideo horiekin. Hori dena cloud-ean (hodeian) dago prest. Azkenik, gure irudia jartzen dugu, zerbitzarietan gure irudia GAN horrekin prozesatu eta bideo biziberritua sortzen da, eta gure sakelakoan gordetzen da».

Vicomtech ikerketa aplikatuko zentro bat da, Donostian du egoitza, eta teknologia digitalean dago espezializatua. Elordik nabarmendu du teknologia horiek guztiek zientzian dutela oinarria, enpresetara doazela gero, eta haiek egiten duten erabileraren arabera sortzen direla eztabaida etikoak eta bestelakoak. «Entretenimenduaren esparruan» ikusten dizkie horrelakoei erabilera gehien: «Aurpegien ordezkapenean, adibidez, aktore bat hil edo zauritzen bada filmatze batean —aurpegia ordezkatu egin daiteke filmatzea gelditu gabe—. Hilda dagoen norbaiten birsortze bat egiteko —Lola Floresekin Cruzcamporen iragarkian egin bezala— Deep Nostalgia aplikazioan, TikTok-ean eta sare sozialetan dibertitzeko...».

Arazoa: manipulazioa

Ikerlaria da Elordi, zientzialaria, eta onartu du badagoela «aldatu ezin daitekeen» zerbait: «Gizakiaren pentsamenduaren natura». Eta hor sortzen dela arazoa: «Jendea manipulatzea». Hor sortzen dela «kezka».

Eta «kezka» berbera partekatzen du Belen Altunak. Balioen Filosofia eta Gizarte Antropologia irakaslea da Altuna, EHUko Filosofia eta Antropologia Fakultatean. Zera dio: «Adimen artifizialak eta errealitate birtualak, oro har, oraindik ikusten hasi baino ez garen eraldaketa handiak ekarriko dizkigu. Zientzietan, ingeniaritzan, medikuntzan eta abarretan abantaila ugari bai, baina baita kezka eta zalantza etikoak ere, noski. Gure ezagutza eta esperientzia bideak handitu ahalko dituzte, baina baita, esaterako, egiaren eta gezurraren arteko aldeak lausotu, edo engainu modu berri eta sofistikatuak sustatu ere».

Altunak, nolabait, bereizi egiten ditu bizidunekin egindako engainu modu berri horiek eta hildakoen irudiekin egiten den erabilera. «Hildako hurbilak badira, baditugu jada haien argazki eta bideoak, eta haiek sare sozialetan irekian zabaltzen baditugu, jada arazoa hor dago: irudi horien kontrola galtzen dugula da arazoa. Eskubide digitalak oraintsu hasi dira babesten, baina atzerrian dagoen zerbitzari batean badaude, ezin dira betearazi».

Altunak beste horrenbeste dio MyHeritage konpainiaren Deep Nostalgia aplikazioari buruz: «Hunkigarria iruditzen zait —negozio bikaina ere bai, jakina—. Berpizte txikiak dira, bai, baina gure hildako zaharrak une batez bederen gogoan izateko balio badute, ez zait gaizki iruditzen. Arazoa sortzen da irudi horiek zabaltzen ditugunean, eta kontrola galdu. Edo manipulatzen ditugunean, beste helburu batzuekin».

Faltsutze sakona

Manipulatu eta beste helburu batzuekin erabili. Hortxe sortzen da, beraz, korapilorik handiena. Gorka Julio BERRIAko kolaboratzaileak eta teknologia berrietan aditu denak horrela iragarri zuen afera Irlen Sarea bere larunbateroko zutabean. 2019ko otsaila zen: «Bideo batean agertzen den pertsona baten irudia beste batekin ordezkatzeko gai diren sistemak garatzen hasi dira. Horrek aukera emango luke edizio askorik egin gabe bideo bat editatu eta bertan agertzen den pertsona bat, adibidez, beste batekin ordezkatzeko; deep fake, faltsutze sakona deitzen hasi zaio horri».

Eta iragartzearekin batera egin zuen Juliok hausnarketa eta bota zuen jada orduan galdera: «Egin edo esan ez dituzun gauzak egia bihur daitezke, bideo batean esaldi horiek esaten dituen pertsonari zure aurpegia eta ahots tonua jartzen badizkiote. Lehen begiratuan, bideoan agertzen den hori, zu ez zaren hori, benetan zu ez zarela jakiterik ez dago. Demagun, gainera, zure bizitzan eragin dezakeen bideo bat dela, eta berau zabaltzen hasten dela sareetan zehar... Teknologia horiek gizarteratzen hasten badira eta horrela izango dela dirudi, zein neurri jar daitezke horren aurrean?».

Bada, hasi dira gizarteratzen, eta egunerokoan egin dute tokia. Kasuak kontaezinak dira. Oihartzunik handiena izan duten azkenak AEBetako presidente Joe Biden eta haren aurreko Donald Trump harrapatu dituzte erdiz erdi. Barack Obama ere jarri dute inoiz eman ez zuen hitzaldi bat ematen, eta Jim Carrey ere bai Jack Nicholsonen tokian The Shining filmean inoiz izan ez zuen rola jokatzen. Sensity konpainiaren arabera, 2018tik hona bikoiztu egiten dira sei hilean behin deep fake-ak. Arrazoia? «Adimen artifizialaren demokratizazioa; teknologiaren eskuragarritasuna».

Horixe aipatu du Belen Altuna EHUko irakasleak ere. Haren iritziz, gisa horretan manipulatutako bideoak «geroz eta arruntagoak» izango dira, adimen artifizialeko teknologia horiek jada «zeharo eskuragarriak» direlako: «Kalte egiteko, xantaia egiteko edo norbaiten izen ona zikintzeko erraz erabil daitezke».

Gorka Juliok bere zutabean aipatu zuen kontrol neurri gehiago jarriko zaizkiola orain bideo horiei sinadura eta algoritmo mailan, eta kontrol hori pribatutasun eskubidearekin bateragarria izatea izango dela erronka nagusia. Antzera mintzo da Altuna: «Norbere ohorea, intimitatea eta irudia babestu beharreko eskubidetzat ditugu. Kontua da: nola aldatu litekeen hori guztia ziberespazio amaigabearen garaian. Sare sozialetan jartzen ditugun argazkiak eta bideoak, zabaltzen direnean, norenak dira?».

Erronka: detekzioa

Eskubideen arloaz bai, baina teknologiak berak sortutako engainua teknologiaren bidez aurkitzeaz ari da gehiago Unai Elordi ikerlaria. Orain lortzen diren deep fake horien maila «oso ona» dela dio, baina badagoela «alarmismo» faktore bat ere: «Normalean, deep fake horiek ikusmen hutsez detekta ditzakegu, eta begiarentzat detektaezinak direnak ezin ditu edonork egin. Ikertzailea, adimen artifizialeko garatzailea edo diseinu munduan ibilitako profesionala izan behar da».

Hala ere, Elordik dio ulertzen duela pertsona famatuen eta politikarien «kezka», deep fake horiek egiten dituztenen «target-etan» daudelako. Teknologia «hor» dagoenez, eta «eskuragarri», argi dauka zein den aurrera begirako erronka : «Deep fake horien detekzio automatikoan lan egitea. Prozesu oso konplexua da, eta erronka garrantzitsua adimen artifizial eta ikusmen artifizialean ari garenenontzat».

Badituztelako mila aurpegi.

Berpizteak baditu milaka aurpegi

Hologramen eta adimen artifizialaren bidez, hildakoak ari dira biziz berritzen. Joandako artistak berriz itzularazteak sortu du eztabaida etikoa, baina hurbilekoak bizirik eta mugimenduan jartzeak estutu du korapiloa. Are da estuagoa bizirik daudenak jartzen badira gezurretan. Engainu mota berria da: 'deep fake'.

Iruzkinak

Ez dago iruzkinik

Ordenatu